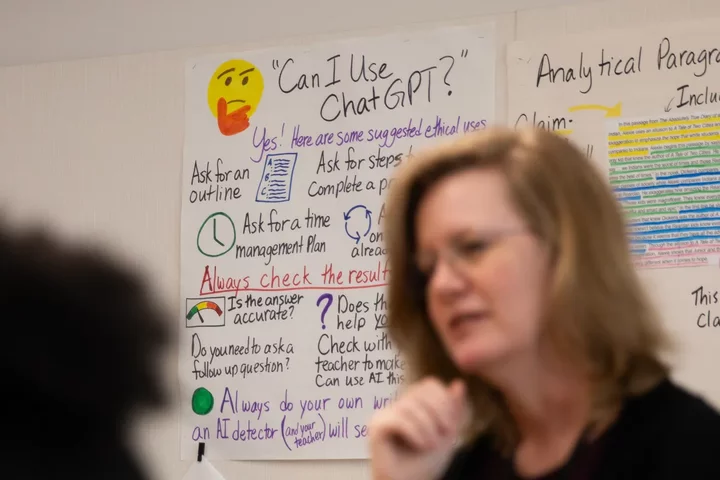

Un cartel con información para los estudiantes sobre el uso de ChatGPT, una plataforma de inteligencia artificial, en la clase de inglés de Jen Roberts en la Escuela Secundaria Point Loma en San Diego el 3 de mayo de 2024. Foto por Adriana Heldiz, CalMatters

Tus hijos podrían ser parte de un creciente número de niños de California cuyos escritos son evaluados por software en lugar de un profesor.

Los distritos escolares de California están firmando más contratos para herramientas de inteligencia artificial, desde calificación automatizada en San Diego hasta chatbots en el centro de California, Los Ángeles y el área de la bahía de San Francisco.

Los profesores de inglés dicen que las herramientas de IA pueden ayudarles a calificar papeles más rápidamente, obtener más retroalimentación de los estudiantes y mejorar su experiencia de aprendizaje. Pero las pautas son vagas y la adopción por parte de profesores y distritos es irregular.

El Departamento de Educación de California no puede decirte qué escuelas usan IA ni cuánto pagan por ella. El estado no rastrea el uso de IA por parte de los distritos escolares, dijo Katherine Goyette, coordinadora de ciencias de la computación del Departamento de Educación de California.

Aunque Goyette dijo que los chatbots son la forma más común de IA que ha encontrado en las escuelas, cada vez más profesores de California están utilizando herramientas de IA para ayudar a calificar el trabajo de los estudiantes. Eso es consistente con encuestas que han encontrado que los profesores usan IA tanto o más que los estudiantes, noticias que contrastan fuertemente con titulares sobre el temor de que los estudiantes hagan trampa con la IA.

Los profesores utilizan la IA para cosas como personalizar material de lectura, crear planes de lecciones y otras tareas para ahorrar tiempo y reducir el agotamiento. Un informe emitido el otoño pasado en respuesta a una orden ejecutiva de IA del gobernador Gavin Newsom menciona oportunidades para utilizar la IA en tutoría, resumen y generación de contenido personalizado, pero también etiqueta a la educación como un caso de uso arriesgado. Las herramientas de IA generativa han sido conocidas por crear respuestas convincentes pero inexactas a las preguntas, y usar lenguaje tóxico o imágenes cargadas de racismo o sexismo.

California emitió orientación sobre cómo los educadores deberían usar la tecnología el otoño pasado, uno de los siete estados en hacerlo. Fomenta el análisis crítico del texto e imágenes creados por modelos de IA y las conversaciones entre profesores y estudiantes sobre lo que constituye un uso ético o apropiado de la IA en el aula.

Pero no se hace mención específica de cómo los profesores deben tratar la IA que califica las tareas. Además, el código de educación de California establece que la guía del estado es “meramente ejemplar, y que el cumplimiento de las directrices no es obligatorio”.

La profesora de inglés Jen Roberts usa Writeable, una plataforma de IA, para calificar el trabajo de los estudiantes en la Escuela Secundaria Point Loma en San Diego el 3 de mayo de 2024. Foto por Adriana Heldiz, CalMatters

Goyette dijo que está esperando a ver si la Legislatura de California aprueba Senate Bill 1288, que requeriría al Superintendente de Educación Tony Thurmond crear un grupo de trabajo de inteligencia artificial para emitir más orientación a los distritos escolares locales sobre cómo usar la inteligencia artificial de forma segura. Avalado por Thurmond, el proyecto de ley también pide una evaluación del estado actual de la inteligencia artificial en la educación y la identificación de formas de inteligencia artificial que pueden dañar a estudiantes y educadores para el año 2026.

Nadie rastrea qué herramientas de inteligencia artificial los distritos escolares están adoptando o la política que utilizan para hacer cumplir los estándares, dijo Alix Gallagher, jefa de alianzas estratégicas en el centro de Análisis de Políticas de Educación de California en la Universidad de Stanford. Dado que el estado no rastrea el plan de estudios que adoptan los distritos escolares o el software que utilizan, sería muy inusual para ellos rastrear contratos de inteligencia artificial, dijo.

En medio del auge de la inteligencia artificial, Gallagher cree que las personas pueden perder de vista el hecho de que la tecnología es solo una herramienta y solo será tan buena o problemática como las decisiones de los humanos que utilizan esa herramienta, por lo que insta repetidamente a invertir en ayudar a los maestros a comprender las herramientas de inteligencia artificial, cómo ser reflexivos sobre su uso y hacer espacio para que las comunidades expresen cómo satisfacer mejor las necesidades de sus hijos.

“Es probable que algunas personas tomen decisiones bastante malas que no estén en el mejor interés de los niños y otras personas encuentren formas de usar, tal vez incluso las mismas herramientas, para enriquecer las experiencias de los estudiantes”, dijo.

Los maestros utilizan inteligencia artificial para calificar los trabajos de inglés

El verano pasado, Jen Roberts, profesora de inglés en la Escuela Secundaria Point Loma en San Diego, asistió a una sesión de capacitación para aprender a usar Writable, una herramienta de inteligencia artificial que automatiza la calificación de tareas de escritura y brinda a los estudiantes comentarios impulsados por OpenAI. Durante el año escolar pasado, Roberts usó Writable y otras herramientas de inteligencia artificial en el aula, y dijo que fue el mejor año de casi tres décadas de enseñanza. Roberts dijo que sus estudiantes han mejorado como escritores, no porque la inteligencia artificial escribiera por ellos, sino porque los comentarios automatizados pueden decirles a sus estudiantes más rápido de lo que ella puede cómo mejorar, lo que a su vez le permite asignar más tareas de escritura.

“En este punto del año pasado, muchos estudiantes aún luchaban por escribir un párrafo, y mucho menos un ensayo con evidencia y argumentos y razonamiento y explicación y elaboración y todo eso”, dijo Roberts. “Este año, simplemente llegan mas rápido allí”.

Roberts siente que Writable es “muy preciso” al calificar a sus estudiantes con aptitudes promedio. Sin embargo, dijo, tiene un inconveniente: a veces asigna notas más bajas de las merecidas a los estudiantes con altas calificaciones y calificaciones más altas a los estudiantes con dificultades. Dijo que rutinariamente verifica las respuestas cuando la inteligencia artificial califica las tareas, pero solo verifica los comentarios que da a los estudiantes ocasionalmente.

“En realidad, no reviso los comentarios que da a cada estudiante”, dijo. “Eso simplemente no es un buen uso de mi tiempo. Pero hago muchas verificaciones y veo qué está pasando, y si veo a un estudiante del que estoy preocupada recibiendo comentarios, [pienso] ‘Permíteme ver cuáles son sus comentarios y luego hablar con él al respecto’”.

Primero: Un estudiante usa Magic School, una plataforma de inteligencia artificial, para ayudar a generar ideas para una tarea de escritura en el aula. Último: Un estudiante lee en voz alta su escritura. Escuela Secundaria Point Loma en San Diego el 3 de mayo de 2024. Fotos por Adriana Heldiz, CalMatters.

Alex Rainey enseña inglés a estudiantes de cuarto grado en la Escuela Diurna del Condado de Chico en el norte de California. Utilizó GPT-4, un modelo de lenguaje creado por OpenAI que cuesta $20 al mes, para calificar trabajos y proporcionar comentarios. Después de cargar su rúbrica de calificación y ejemplos de sus comentarios por escrito, utilizó la inteligencia artificial para calificar trabajos sobre mecanismos de defensa animal, permitiendo a GPT-4 analizar la gramática y la estructura de las oraciones de los estudiantes mientras ella se enfocaba en evaluar la creatividad.

“Siento que los comentarios que dio fueron muy similares a cómo yo califico a mis hijos, como si mi cerebro estuviera conectado a él”, dijo.

Al igual que Roberts, encontró que ahorra tiempo, transformando trabajos que llevaban horas en menos de una hora, pero también descubrió que a veces GPT-4 es un calificador más estricto que ella. Coincide en que los comentarios más rápidos y la capacidad de asignar más tareas de escritura produce mejores escritores. Un maestro puede asignar más escritos antes de dar retroalimentación, pero “luego los niños no tienen de qué crecer”.

Rainey dijo que su experiencia calificando con GPT-4 la dejó de acuerdo con Roberts, que más retroalimentación y escribir más a menudo produce mejores escritores. Ella siente firmemente que los maestros todavía necesitan supervisar la calificación y retroalimentación por IA, “pero creo que es asombroso. No podría retroceder ahora”

El costo de usar IA en el aula

Los contratos que involucran inteligencia artificial pueden ser lucrativos.

Para lanzar un chatbot llamado Ed, Los Angeles Unified School District firmó un contrato de $6.2 millones por dos años con opción de renovación por tres años adicionales. Magic School AI es utilizada por educadores en Los Ángeles y cuesta $100 por maestro por año.

A pesar de llamadas y correos electrónicos repetidos a lo largo de aproximadamente un mes, Writable y el Distrito Escolar Unificado de San Diego se negaron a compartir detalles de precios con CalMatters. Un portavoz del distrito dijo que los maestros tenían acceso a Writeable a través de un contrato con Houghton Mifflin Harcourt para estudiantes de inglés como segundo idioma.

QuillBot es una herramienta de escritura con IA para estudiantes de los grados 4-12 creada por la compañía Quill. Quill dice que su herramienta es actualmente utilizada en 1,000 escuelas en California y tiene más de 13,000 usuarios de estudiantes y educadores solo en San Diego. Una suscripción anual a Quill Premium cuesta $80 por maestro o $1800 por escuela.

QuillBot no genera escritura para estudiantes como ChatGPT o califica tareas de escritura, pero les brinda retroalimentación a los estudiantes sobre su escritura. Quill es una organización sin fines de lucro que ha recaudado $20 millones de grupos como la fundación benéfica de Google y la fundación Bill y Melinda Gates en los últimos 10 años.

La profesora de inglés Jen Roberts explica a sus estudiantes cómo usa Magic School, una plataforma de IA, para ejercicios en el aula y calificaciones en Point Loma High School en San Diego el 3 de mayo de 2024. Foto de Adriana Heldiz, CalMatters

Incluso si un maestro o distrito quiere invertir en una herramienta de IA, aún se está trabajando en la orientación para un uso seguro y responsable.

Los gobiernos están colocando etiquetas de alto riesgo en formas de IA con el poder de tomar decisiones críticas sobre si una persona obtiene un trabajo o alquila un apartamento o recibe beneficios del gobierno. El presidente de la Federación de Maestros de California, Jeff Freitas, dijo que no ha considerado si la IA para calificar es de riesgo moderado o alto, pero “definitivamente es un riesgo usarla para calificar”.

La Federación de Maestros de California es un sindicato con 120,000 miembros. Freitas dijo a CalMatters que está preocupado por la IA que tiene una serie de consecuencias en el aula. Le preocupa que los administradores puedan usarla para justificar el aumento del tamaño de las clases o aumentar la carga de trabajo de los maestros; le preocupa el cambio climático y la cantidad de energía necesaria para entrenar y desplegar los modelos de IA; le preocupa proteger la privacidad de los estudiantes y le preocupa el sesgo de automatización.

Los reguladores de todo el mundo que luchan contra la IA elogian enfoques en los que se utiliza para mejorar la toma de decisiones humanas en lugar de reemplazarla. Pero es difícil que las leyes se ajusten al sesgo de automatización y a los humanos que confían demasiado en las máquinas.

La Federación Estadounidense de Maestros creó un grupo de trabajo de IA en octubre de 2023 para proponer orientación sobre cómo los educadores deben usar la tecnología o hablar sobre ella en negociaciones de contratos de negociación colectiva. Freitas dijo que esas pautas se publicarán en las próximas semanas.

“Estamos tratando de proporcionar pautas para que los educadores no confíen únicamente en (la IA)”, dijo. “Debería usarse como una herramienta, y no deberías perder tu análisis crítico de lo que está produciendo para ti.”

Directrices estatales de IA para maestros

Goyette, la coordinadora de informática del departamento de educación, ayudó a crear directrices estatales de IA y habla con las oficinas de educación del condado para capacitación presencial sobre IA para educadores. También ayudó a crear una serie de entrenamientos en línea de IA para educadores. Ella dijo que el curso en línea más popular trata sobre flujo de trabajo y eficiencia, que muestra a los maestros cómo automatizar la planificación de lecciones y la calificación.

“Los maestros tienen un trabajo increíblemente importante y difícil, y lo más importante es que están construyendo relaciones con sus estudiantes”, dijo. “Hay décadas de investigaciones que hablan del poder de eso, así que si pueden ahorrar tiempo en tareas mundanas para poder pasar más tiempo con sus estudiantes, eso es una victoria.”

La profesora de inglés Jen Roberts revisa el trabajo de su estudiante en Point Loma High School en San Diego el 3 de mayo de 2024. Roberts utiliza plataformas de inteligencia artificial para ejercicios y calificaciones en el aula. Foto de Adriana Heldiz, CalMatters

Alex Kotran, director ejecutivo de una organización educativa respaldada por Google y OpenAI, dijo que descubrieron que es difícil diseñar un modelo de lenguaje para predecir cómo un maestro califica los exámenes.

Él habló con profesores dispuestos a aceptar un modelo que es preciso el 80% del tiempo para cosechar la recompensa del tiempo ahorrado, pero cree que probablemente es seguro decir que un estudiante o padre querría asegurarse de que un modelo de IA utilizado para calificar sea aún más preciso.

Kotran del Proyecto de Educación en IA piensa que tiene sentido que los distritos escolares adopten una política que diga que los profesores deben tener cuidado cada vez que usan herramientas de IA que pueden tener efectos dispares en la vida de los estudiantes.

Incluso con tal política, los profesores aún pueden caer en la trampa de confiar en la IA sin cuestionarla. Y aunque el estado registre la IA utilizada por los distritos escolares, todavía existe la posibilidad de que los profesores compren tecnología para usar en sus computadoras personales.

Kotran dijo que habla regularmente con educadores en todo Estados Unidos y no tiene conocimiento de ningún estudio sistemático para verificar la eficacia y consistencia de la IA para calificar exámenes de inglés.

Cuando los profesores no pueden decir si están haciendo trampa

Roberts, la profesora de Point Loma High School, se describe a sí misma como pro-tecnología.

Ella escribe y habla regularmente sobre IA. Sus experiencias la han llevado a la opinión de que calificar con IA es lo mejor para sus estudiantes, pero no llegó a esa conclusión fácilmente.

Al principio se preguntaba si usar IA para calificar y dar retroalimentación podría perjudicar su comprensión de los estudiantes. Hoy ve el uso de la IA como el entrenador de campo que va junto a los atletas en un carrito de golf, como una ayuda que le ayuda a asistir mejor a sus estudiantes.

Ella dice que el profesor promedio de inglés de secundaria en su distrito tiene aproximadamente 180 estudiantes. Calificar y dar retroalimentación puede llevar entre cinco y diez minutos por tarea, dice ella, por lo que entre la enseñanza, reuniones y otras tareas, puede llevar dos o tres semanas devolver la retroalimentación a los estudiantes a menos que un profesor decida renunciar a grandes porciones de sus fines de semana. Con la IA, a Roberts le lleva un día o dos.

Finalmente concluyó que “si mis estudiantes están mejorando como escritores, entonces no creo que esté haciendo trampas”. Ella dice que la IA reduce su fatiga, dándole más tiempo para centrarse en los estudiantes con dificultades y darles una retroalimentación más detallada.

“Mi trabajo es asegurarme de que crezcas y de que seas un adulto letrado, sano y feliz cuando te gradúes de la secundaria, y utilizaré cualquier herramienta que me ayude a hacerlo, y no me voy a obsesionar con los aspectos morales de eso”, dijo. “Mi trabajo no es pasar todos los sábados leyendo ensayos. Demasiados profesores de inglés trabajan demasiadas horas a la semana porque están calificando a los estudiantes de la manera tradicional”.

Roberts también piensa que la IA podría ser una calificadora menos sesgada en algunos casos que los profesores humanos que pueden ajustar su calificación para los estudiantes a veces para darles el beneficio de la duda o ser punitivos si han sido particularmente molestos recientemente en clase.

Ella no está preocupada por que los estudiantes hagan trampa con la IA, una preocupación que caracteriza como una alarma moral. Ella señala un estudio de la Universidad de Stanford publicado el otoño pasado que encontró que los estudiantes hacen trampa tanto antes de la aparición de ChatGPT como un año después de la liberación de la IA.

Goyette dijo que entiende por qué los estudiantes cuestionan si algunos usos de la IA por parte de los profesores son como hacer trampa. Las pautas de la IA del departamento de educación alientan a los profesores y estudiantes a usar más la tecnología. Lo esencial, dijo Goyette, es que los profesores discutan cómo se ve el uso ético de la IA en su aula, y transmitan que — como usar una calculadora en clase de matemáticas — usar la IA es aceptado o recomendado para algunas tareas y no para otras.

Para la última tarea del año, Robers tiene un experimento final que realizar: Editar un ensayo escrito completamente por inteligencia artificial. Pero deben cambiar al menos el 50% del texto, hacerlo un 25% más largo, escribir su propia tesis y agregar citas del material de lectura en clase. La idea, dijo, es prepararlos para un futuro en el que la IA escriba el primer borrador y los humanos editen los resultados para que se ajusten a sus necesidades.

“Solía ser que no se permitía llevar una calculadora a los SAT y ahora se supone que debes llevar tu calculadora, así que las cosas cambian”, dijo. “Es solo pánico moral. Las cosas cambian y la gente se asusta y eso es lo que está sucediendo.”

###

CalMatters.org es una empresa de medios sin fines de lucro y no partidista que explica las políticas y la política de California.

CLICK TO MANAGE